心法二:精煉循環 — 迭代的雙面刃與平台思維

上一篇我們建立了工作流程的前兩個階段:把獨立的 A、B、C 串成工作流程,然後設計 Context 的交接。當你用這個工作流程實際跑了一陣子之後 — 恭喜,你完成了第一步。

但也只是第一步。因為你只是把 你原本的工作流程 用 AI 實現了。這個工作流程隨著 AI 的介入,一定會出現變化的地方 — 有些步驟變快了、有些步驟反而多了新問題、有些人類的判斷現在需要被明確化。

這時候進入精煉循環。

用 /insight 做診斷

善用 /insight 指令(或類似的診斷工具)來檢視整個工作流程:

- 人類介入的地方是否合理?

- AI 使用上有什麼缺失或低效?

- 哪些重複的操作可以被自動化?

/insight 通常會給你一堆建議,其中很多會是「把這個加進你的 CLAUDE.md」。

但等等 — 想想前七篇學到的東西。

CLAUDE.md 應該是 極度精簡 的(第三篇的 Token 預算:<60 行)。不是所有東西都該往 CLAUDE.md 塞。你需要做的是 分類:

- 全域的基礎原則(身份、核心規則)→ 放 全域 CLAUDE.md — 每次對話都載入,必須精簡

- 專案特定的規範(coding style、架構規則)→ 放 專案的 CLAUDE.md — 只在該專案中載入

- 常用的方法論(分析框架、審查流程)→ 放 Skill — 按需載入,Progressive Disclosure

- 必須遵守的硬性規則 → 放 Rule — 不可覆寫的約束

- 系統層級的自動化(commit 前檢查)→ 放 Hook / Script — 寫死在系統裡,不依賴 AI 記住

這個分類的本質,其實就是第三篇 Context Engineering 的 JIT 原則在工作流程層面的應用:不是所有知識都該一次載入,不是所有規則都該放在同一個地方。

UX Planet 的一篇 CLAUDE.md 最佳實踐分析 [16] 也印證了這點:最成功的 Claude Code 使用者都在「obsessively manage context」— 包括精心維護 CLAUDE.md 檔案、積極使用 /clear、建立 living plans 文件系統,以及設計 token-efficient 的工具。這不是偶然,而是 Context Engineering 的自然結果。

小提醒:/insight 的結果跟目錄有關

/insight 有時會根據你執行的目錄給出不同的建議,雖然他會抓取所有的對話紀錄,但因為他會過濾不相關的對話,所以如果你在不同的目錄下跑它,而且這個目錄有自己的 .claude 設定,那 Insight Report 會因為過濾的對話不同,有時你會得到不同的結果,這不是 bug,這是 Context-aware 的特性。

警告:迭代的雙面刃

精煉循環是有效的 — arXiv 上的 Self-Refine 研究 [1] 顯示,迭代改進對比一次性生成,平均提升約 20%。ICLR 2025 的研究 [5] 也發現,在數學任務上迭代 pipeline 超越單次 baseline 達 +11%。

但迭代本身是一把雙面刃,它有三個你必須注意的風險:

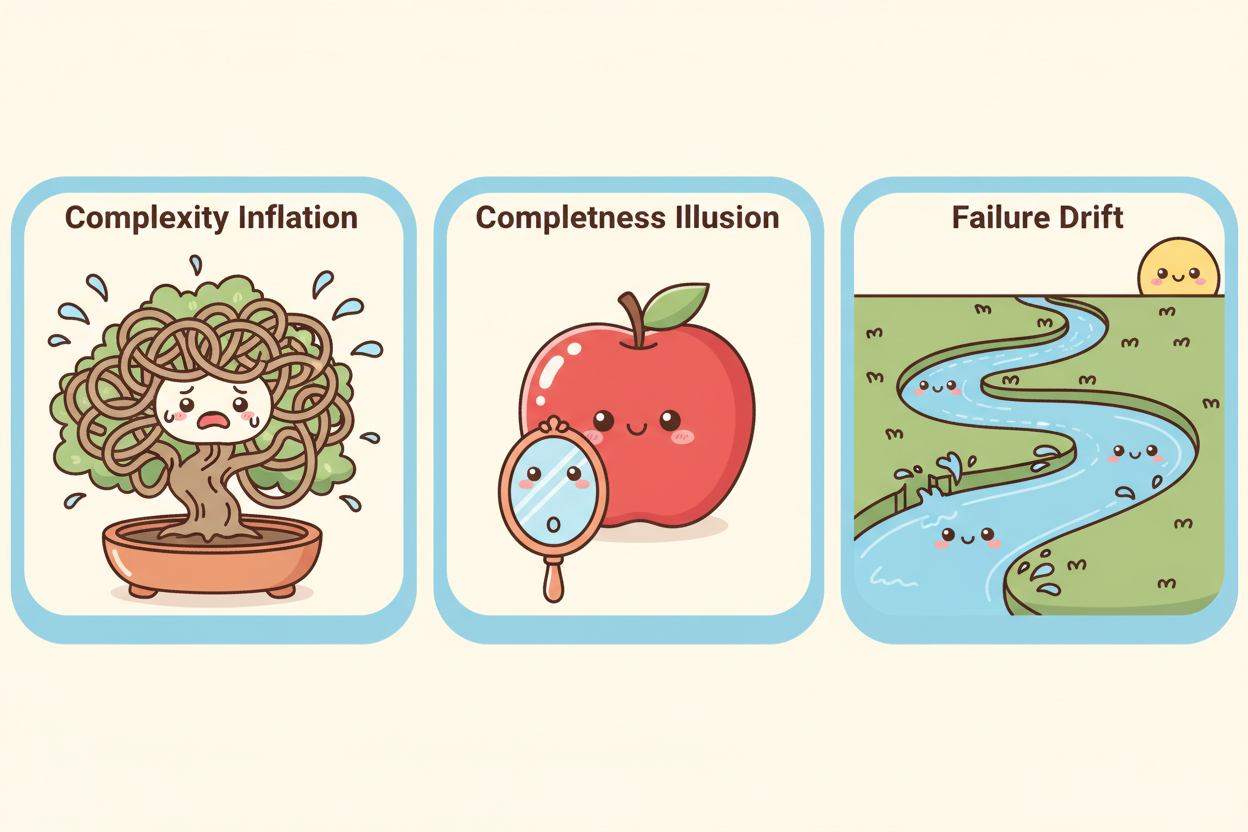

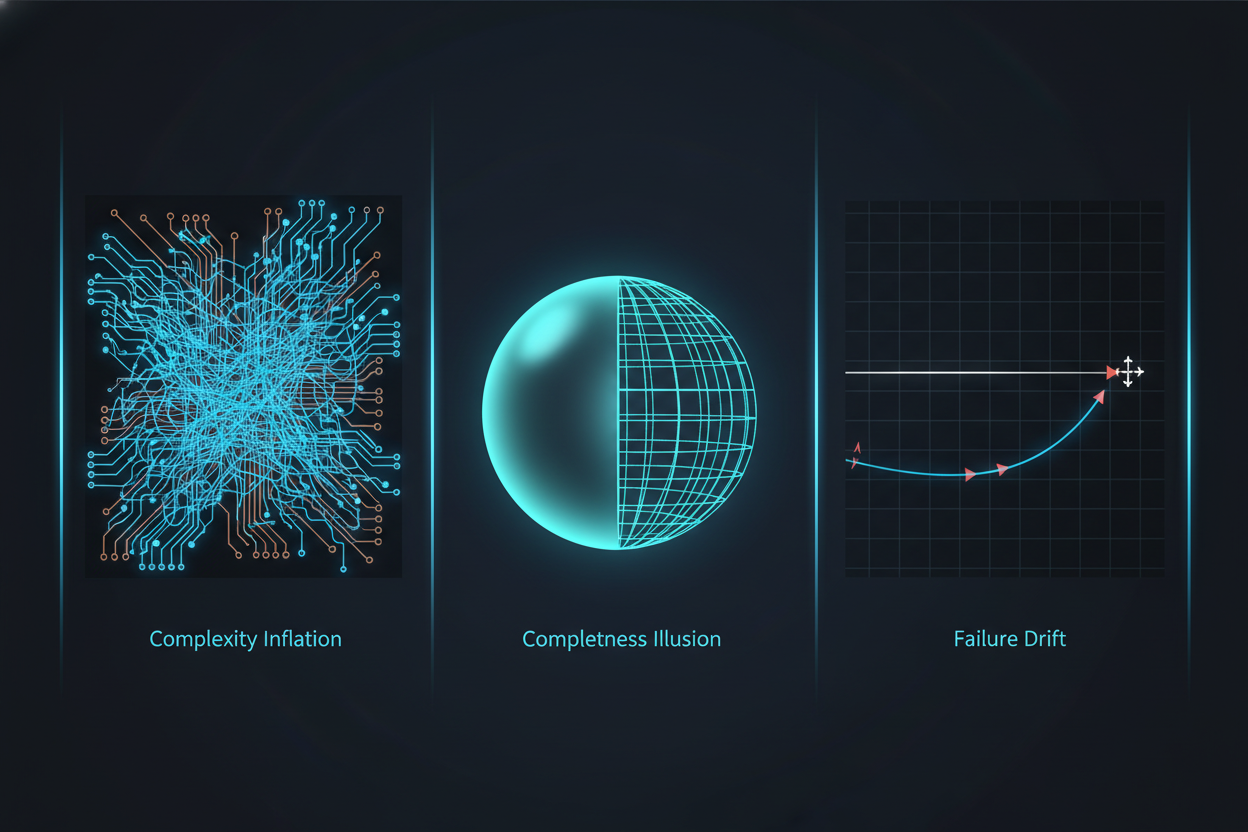

風險一:複雜度膨脹(Complexity Inflation)

每次迭代傾向「增加」而非「簡化」。GitClear 對 2.11 億行程式碼變更的縱向分析 [15](2020-2024)發現,AI 輔助開發的重構比例從 2021 年的 25% 降至 2024 年的不到 10%,而程式碼重複量增加了約 4 倍。換句話說,每一輪迭代都在加東西,但很少有人在減東西。

風險二:完整性幻覺(Illusion of Completeness)

AI 生成的內容在未經訓練的眼中看起來完美。人腦天生傾向填補缺失資訊 — 當你檢視 AI 的輸出時,大腦會本能地補全明顯的缺口,使結果看起來比實際更「完整」。更危險的是,隨著輸出越來越精緻,人類會越來越少做批判性審查。Springer 2025 年的一項研究 [7] 指出,automation bias 已成為人機協作的關鍵挑戰:正面的第一印象會助長對自動化的過度信任,高工作負荷和時間壓力更會強化這種過度依賴。

風險三:失敗漂移(Failure Drift)

LessWrong 上一篇深入分析 [17] 提出了一個重要概念:failure drift — 每次迭代修復了一個感知到的缺陷,但同時不知不覺引入了同一根本問題的新版本。系統陷入「過度修正模式」,引導修正的元過程本身就是錯位的。除非你明確建模「迭代改進如何改變先前失敗的本質」,否則永遠容易受 failure drift 影響。

DEV Community 上一項關於迭代 review-fix 循環的數學分析 [18] 更直接地指出:迭代有精確度天花板,無論執行多少輪都無法超越。 而且,當評估者與生成者有相同盲點時,迭代只是在重新排列錯誤,而非消除它們。實務上,前 1-2 輪帶來最大改善;關鍵內容建議 3-5 輪,一般內容 2 輪即可;超過此數,回報急劇遞減。

所以迭代的正確姿勢是什麼?

把好處跟風險放在一起看:

- 改善幅度 — 好處:對比一次性生成,平均提升 ~20% [1];風險:超過 2 輪後回報急劇遞減 [18]

- 品質走向 — 好處:前 1-2 輪顯著改善 [5];風險:之後可能進入 failure drift [17]

- 複雜度 — 好處:逐步完善系統;風險:每次迭代傾向增加而非簡化 [15]

- 人類審查 — 好處:每輪都有修正機會;風險:輸出越精緻,人類越少批判性審查 [7]

迭代不是壞事,但 不受控的迭代 是。你需要在迭代循環中加入明確的檢查點:

- 設定迭代上限 — 一般精煉 2 輪,關鍵決策 3-5 輪,超過就停下來重新審視

- 每輪檢查複雜度 — 這輪迭代是在「加東西」還是「簡化」?如果連續三輪都在加,暫停

- 引入外部視角 — 這就是下一篇要談的「交叉稽核」原則,它是打破 failure drift 最有效的方法

- 保持懷疑 — 輸出看起來越完美,越要多花一秒鐘想:「這裡有沒有我沒看到的問題?」

從小步快跑到平台思維

這個階段還有一個更宏觀的思維轉變需要發生。

在第一、二階段,小步快跑是對的 — 你需要快速驗證邏輯和思維,確認工作流程的基本假設是否成立。但當你完成了第一個完整的工作流程,開始進入反覆精煉的階段時,你需要開始用平台思維來看整體的基礎設施。

Kissflow 的 2026 趨勢報告 [24] 指出:把 agentic AI 視為漸進式改善的組織,會落後於建構完整平台的組織。Menlo Ventures 的數據 [11] 更具體 — AI 採用率高達 78%,但只有 21% 的組織進行了深層的工作流程重設計。

這代表什麼?大部分組織停留在「局部優化」— 把 A 做得很好、B 做得很好,但因為缺乏平台思維,A 跟 B 之間有巨大的斷裂和漏洞。

所以第三階段的精煉,不只是精煉單一工作流程,而是要定期退後一步,用全局的視角審視:

- 不同工作流程之間有沒有重複的 Skill 或 Context?

- 治理機制(governance)是否涵蓋了所有工作流程,還是只覆蓋了你最常用的那幾個?

- 如果現在加入一個新的工作流程,現有的基礎設施能不能支撐它,還是要從頭來?

IBM 的 AI Governance 指南 [23] 也提到,governance 正從「事後審計」轉變為嵌入 pipeline 的 circuit breaker — 讓審批和稽核追蹤如同 code commits 般整合進工作流程。這就是平台思維的具體體現。

小步快跑驗證想法,平台思維鞏固基礎。 兩者不是互斥的,而是不同階段的重點。

下一篇,我們談工作流程的後半段 — 演進到 Agent Team、發現人類的價值,以及貫穿整個心法的三個核心原則。

參考連結

[1] Madaan et al., “Self-Refine: Iterative Refinement with Self-Feedback” https://arxiv.org/abs/2303.17651

[5] “Think Thrice Before You Act” (ICLR 2025) — 迭代 pipeline 在數學任務上的效果 https://proceedings.iclr.cc/paper_files/paper/2025/file/6882dbdc34bcd094e6f858c06ce30edb-Paper-Conference.pdf

[7] “Exploring Automation Bias in Human-AI Collaboration” (Springer, 2025) https://link.springer.com/article/10.1007/s00146-025-02422-7

[11] Menlo Ventures, “State of GenAI in Enterprise 2025” — 78% 採用率 vs 21% 深層重設計 https://menlovc.com/perspective/2025-the-state-of-generative-ai-in-the-enterprise/

[15] GitClear 縱向分析(2.11 億行,2020-2024)— AI 輔助開發的重構比例下降,重複量增加 4 倍 https://arxiv.org/abs/2512.11922

[16] UX Planet, “CLAUDE.md Best Practices” — 成功使用者 obsessively manage context https://uxplanet.org/claude-md-best-practices-1ef4f861ce7c

[17] LessWrong, “The Illusion of Iterative Improvement” — failure drift 概念 https://www.lesswrong.com/posts/QMqdrTfmuJXsAcopq/the-illusion-of-iterative-improvement-why-ai-and-humans-fail

[18] DEV Community, “Iterative Review-Fix Loops Formula” — 迭代精確度天花板的數學分析 https://dev.to/yannick555/iterative-review-fix-loops-remove-llm-hallucinations-and-there-is-a-formula-for-it-4ee8

[23] IBM, “AI Governance Implementation Guide” — governance 嵌入 pipeline https://www.ibm.com/think/insights/ai-governance-implementation

[24] Kissflow, “7 AI Workflow Automation Trends 2026” — 平台思維 vs 漸進式改善 https://kissflow.com/workflow/7-workflow-automation-trends-every-it-leader-must-watch-in-2025/

支持這個系列

如果這系列文章對你有幫助,考慮請我喝杯咖啡

請我喝杯咖啡